Campo Diagnóstico. IA y diagnóstico: sesgo de automatización, sesgo de espectro y falacia de la tasa base

Introducción

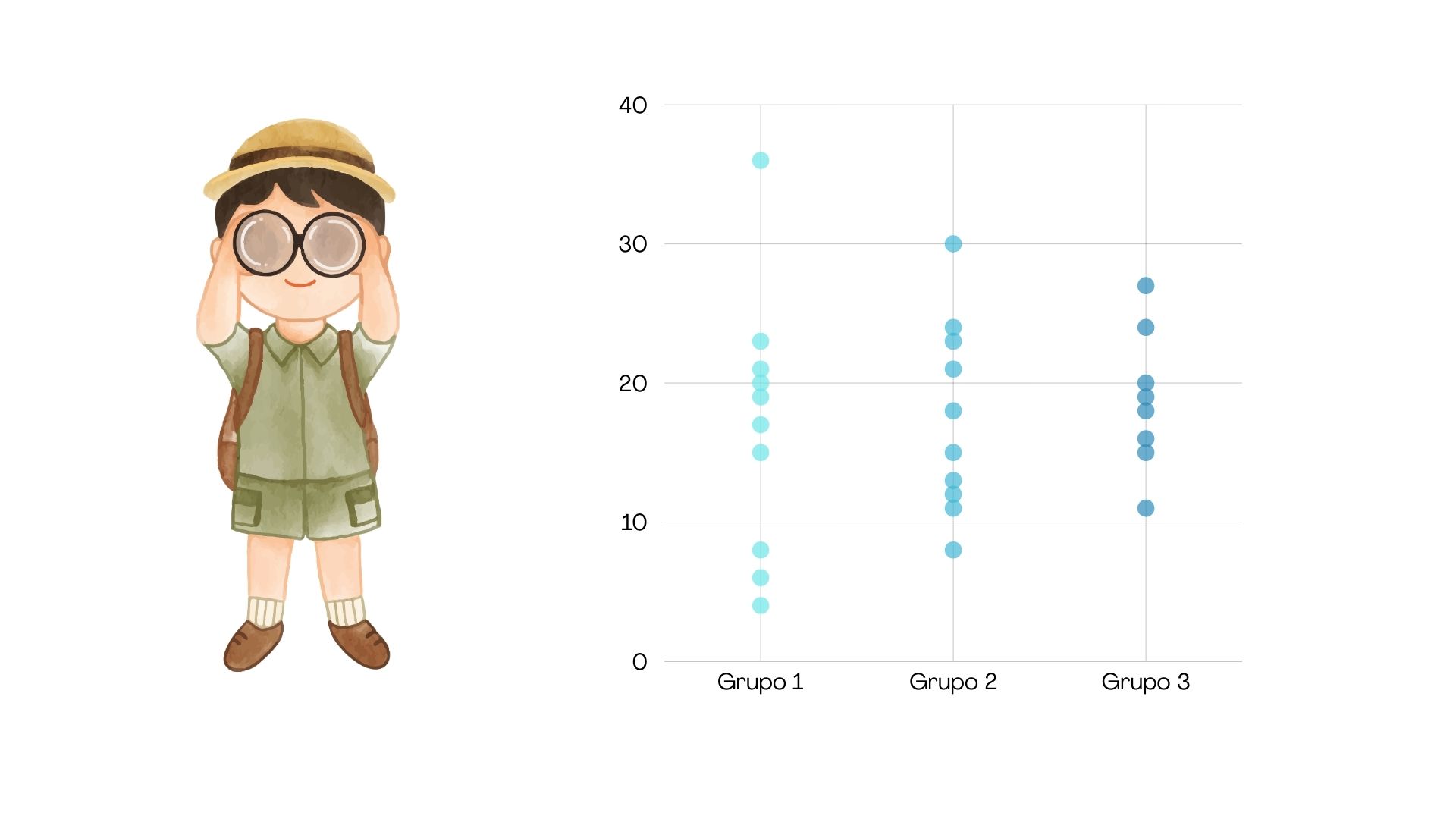

En un artículo reciente publicado en la revista «Diagnosis» (1), Weissman y Zwaan definen el concepto de «campo diagnóstico» como los diferentes diagnósticos que teóricamente podemos encontrar en un entorno clínico, ya sea un área geográfica o una comunidad.

Los autores quieren realzar la importancia de este concepto en relación con la inteligencia artificial (IA) cuando se utiliza como ayuda al diagnóstico clínico. Definieron otros conceptos como «campo considerado», que es el conjunto de diagnósticos planteados por los médicos y los pacientes durante el encuentro diagnóstico, y «campo observado» como aquellos diagnósticos registrados en un momento, correctos o no. El objetivo de los autores al definir estos conceptos es dar consejos sobre la importancia de la composición del campo diagnóstico cuando entrenamos una IA como herramienta de ayuda para el diagnóstico y, al mismo tiempo, mejorar algún sesgo en relación con el proceso de razonamiento clínico del profesional, derivado de este entrenamiento «incorrecto» de la herramienta de IA en ese entorno particular. Quieren mostrar la interacción directa entre la herramienta y los posibles sesgos asociados durante el proceso de razonamiento clínico.

IA, Razonamiento Clínico y Sesgos

En el artículo, los autores enumeran algunas situaciones que pueden ocurrir cuando el entrenamiento de la herramienta de IA no considera aspectos como la prevalencia, la distribución geográfica o las particularidades de la población, lo que puede conducir a un razonamiento clínico sesgado, por parte del profesional que a su vez utiliza las herramientas informáticas. Estas incluyen:

Sesgo de automatización: este sesgo se produce cuando el clínico cree sin reservas en la recomendación de una herramienta de IA que incorpora diagnósticos poco comunes, pero que normalmente se han incluido en el campo diagnóstico, debido a factores emocionales o de sesgo de disponibilidad, lo que altera la real prevalencia del diagnóstico (diagnósticos falsos positivos).

Sesgo de espectro: cuando la herramienta de IA se ha entrenado en un entorno o población muy específicos, su precisión puede verse comprometida si se aplica en otros contextos (validez externa).

Falacia de la tasa base: Un profesional clínico puede incurrir en este tipo de sesgo cuando ignora la prevalencia de un diagnóstico en una población al estimar la probabilidad de dicha enfermedad en un paciente, a veces por razones de representación o disponibilidad. Si una herramienta de IA se entrena en una base de datos que incluye estos diagnósticos sobrerepresentados, se obtendrá una representación falsa de las probabilidades de dicho diagnóstico.

Conclusión

La IA es una herramienta potente con un enorme potencial para ayudar a los profesionales sanitarios durante el proceso de diagnóstico. La IA debe entrenarse con datos reales obtenidos de diferentes fuentes, pero, al igual que la mente humana, el resultado depende en gran medida de la buena calidad de los datos, es decir, que sean representativos de la población, ponderados y lo más objetivos posible.

Bibliografía

- Weissman GE, Zwaan L, Bell SK. Diagnostic scope: the AI can´t see what the mind doesn´t know. Diagnosis(Berlin).2024 Dec 4;12(2): 189-196 . LINK HERE

- Jabbour S, et al. Measuring the impact of AI in the diagnosis of hospitalized patients: a randomized clinical vignette survey study. JAMA 2023; 330:2275-84

- Bar-Hillel M. The base-rate fallacy in probability judgment. Acta Psychologica. 1980;44:211-33

Autor: Lorenzo Alonso Carrión

FORO OSLER